1. anaconda에서 가상환경 생성(python 3.7)

conda create -n tf115 python==3.7

conda activate tf115

2. mask rcnn 을 다운받는다

git clone https://github.com/matterport/Mask_RCNN

3. keras 2.1.2

pip install keras==2.1.2

4. pip install tensorflow-gpu==1.15.5

pip install tensorflow-gpu==1.15.5

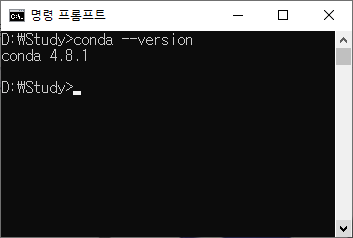

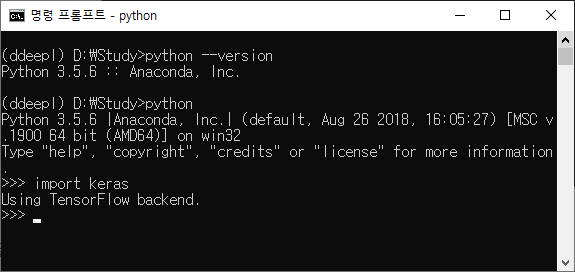

5. 버전 확인을 해본다

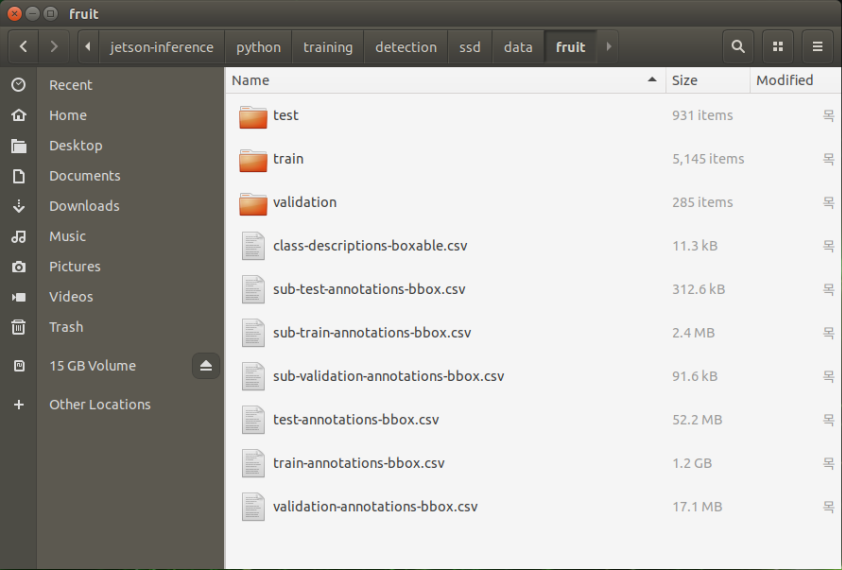

6. 다음과 같이 폴더를 만든다

Mask_RCNN - model - balloon - datasets

- logs

7. 1) https://github.com/matterport/Mask_RCNN/releases/download/v2.1/mask_rcnn_balloon.h5 파일을 다운받아서

Mask_RCNN 폴더로 복사

2) https://github.com/matterport/Mask_RCNN/releases/download/v1.0/mask_rcnn_coco.h5 파일도 다운 받아서 Mask_RCNN 폴더로 복사

3) https://github.com/matterport/Mask_RCNN/releases/download/v2.1/balloon_dataset.zip 파일을 다운받아서 Mask_RCNN/model/balloon/datasets 폴더에 해제

8. 다음의 명령어로 설치

pip install scikit-image

#train 시 문제때문에 다음과 같이 수정해야 한다

pip install -U scikit-image==0.16.2

8. samples/balloon 폴더로 이동한 뒤 다음의 명령어로 inference 실행

python balloon.py --dataset ../../model/balloon/datasets --weights ../../mask_rcnn_balloon.h5 --logs ../../model/balloon/logs --image ../../model/balloon/datasets/val/3800636873_ace2c2795f_b.jpg splash9. inference할 이미지

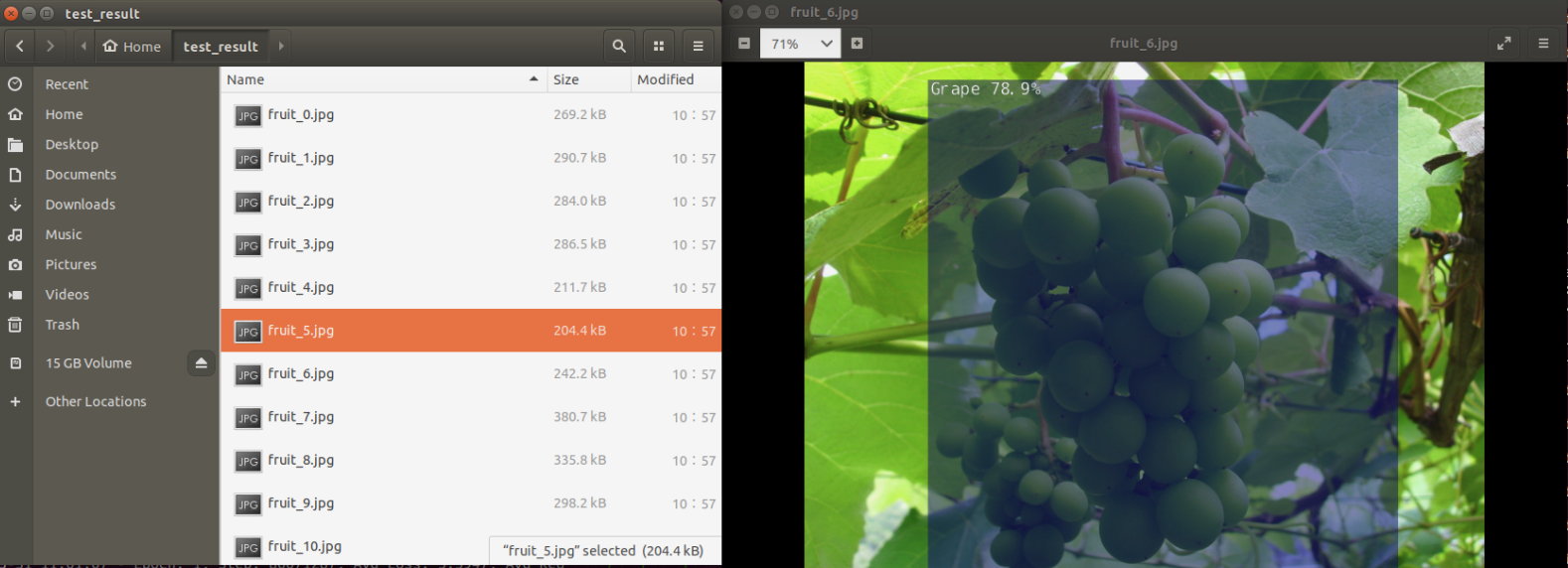

inferernce 결과 이미지가 현재 폴더에 남는다

** 2022년 6월 17일 - 설치테스트 시 아래의 명령을 한번 더 줘야 한다

pip install protobuf==3.20.*

'인공지능' 카테고리의 다른 글

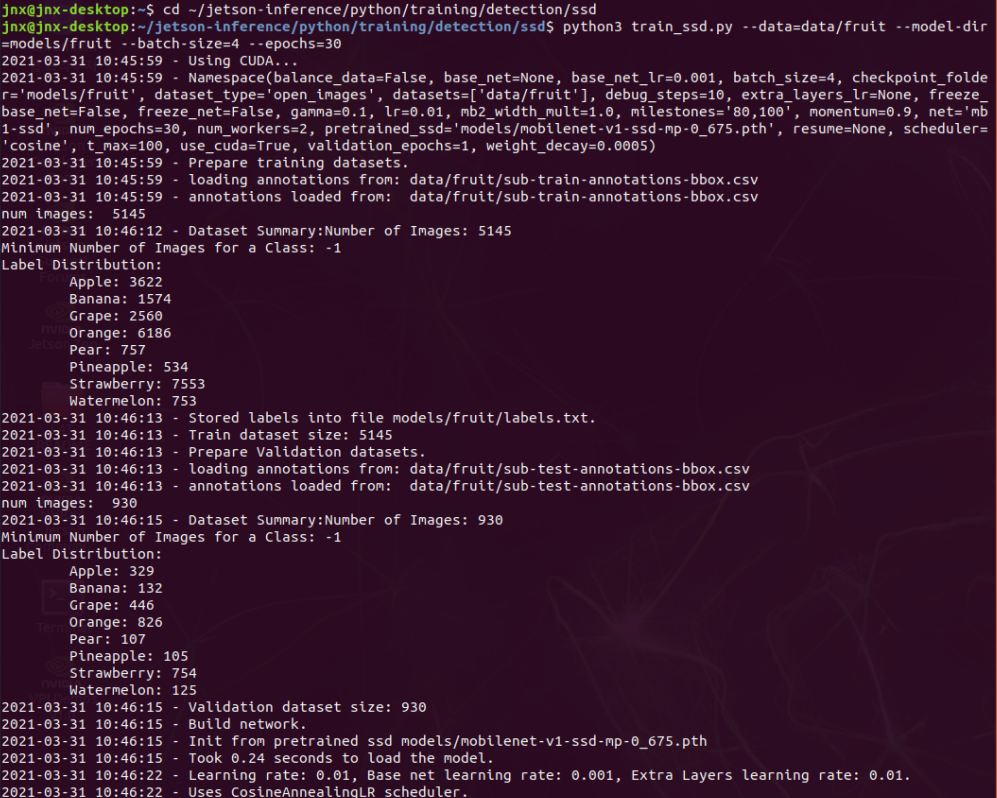

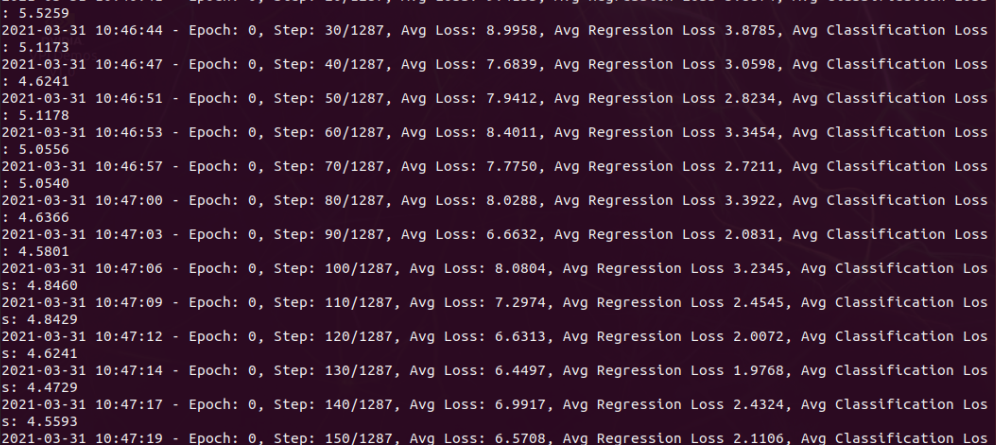

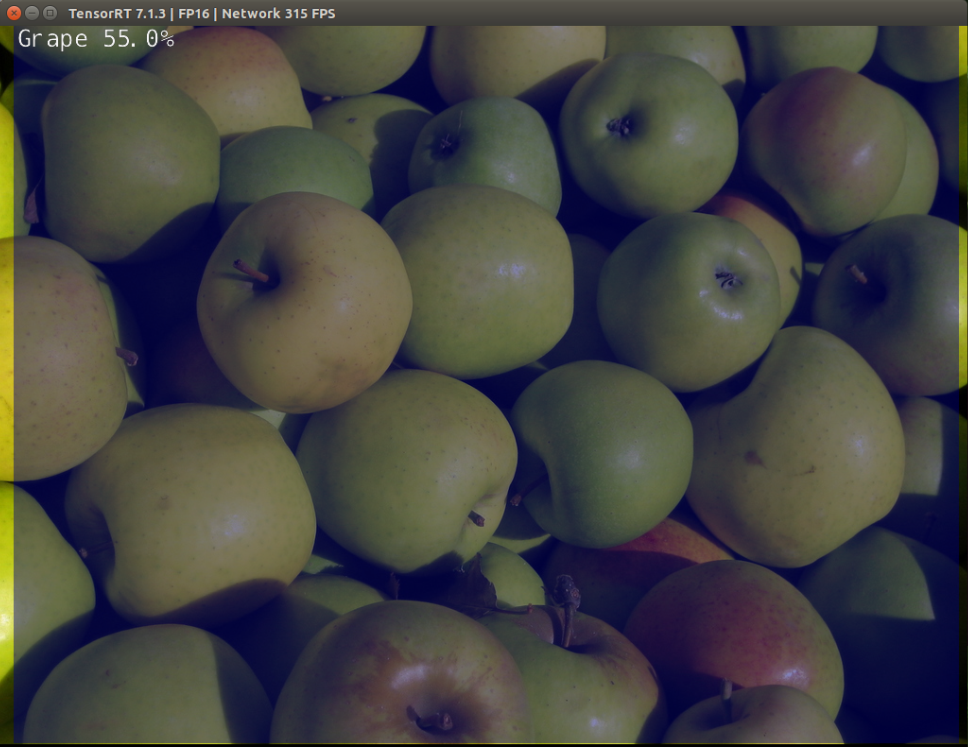

| Jetson Xavier NX 에서 Object Detection TensorRT 학습하기 (0) | 2021.03.31 |

|---|---|

| jetson-nano, jetson-xavier ssd-mobilenet-v2 realtime inference (0) | 2021.03.24 |

| AutoML / mnist / keras (0) | 2020.03.06 |

| '딥다 딥러닝' 다시 시작하자 (케라스 설치부터) (0) | 2020.01.11 |